Des chercheurs de l’Université de Leibniz à Hanovre ont conçu un système nerveux artificiel qui permettrait aux intelligences artificielles de ressentir la douleur. La volonté des chercheurs n’est évidemment pas de « faire souffrir » de pauvres robots, mais de les faire réagir aux situations qui risqueraient de les endommager. Un peu comme un humain, un robot qui a mal pourra arrêter l’action qui entraîne sa détérioration. Si l’idée est ingénieuse, elle est aussi vertigineuse ! Quid d’une intelligence artificielle capable de ressentir physiquement et par la même occasion de comprendre la douleur humaine ? De l’intelligence artificielle à la conscience artificielle… Les robots auront-ils bientôt des émotions ?

La notion de conscience artificielle

L’émotion, la conscience, sont des concepts qui nous semblent essentiels au fonctionnement de notre cerveau et, du coup, à la fabrication d’un robot qui serait à notre image. Aujourd’hui, les intelligences artificielles sont capables de beaucoup. Elles peuvent reproduire une action ou un comportement humain à l’identique, s’adapter à nos émotions, à nos humeurs, pour nous fournir une réponse adaptée quant à la tâche pour laquelle nous les avons programmées. Elles peuvent même devenir de plus en plus performantes grâce aux techniques du deep learning, et enfin dépasser les performances humaines !

L’émotion, la conscience, sont des concepts qui nous semblent essentiels au fonctionnement de notre cerveau et, du coup, à la fabrication d’un robot qui serait à notre image. Aujourd’hui, les intelligences artificielles sont capables de beaucoup. Elles peuvent reproduire une action ou un comportement humain à l’identique, s’adapter à nos émotions, à nos humeurs, pour nous fournir une réponse adaptée quant à la tâche pour laquelle nous les avons programmées. Elles peuvent même devenir de plus en plus performantes grâce aux techniques du deep learning, et enfin dépasser les performances humaines !

Une belle imitation donc, mais du côté du ressenti par contre, l’intelligence artificielle est encore et toujours une machine. Mettre en place une conscience artificielle nécessite de faire en sorte que le robot comprenne son environnement ; simuler un comportement n’est pas ressentir ; c’est tout du moins ce qu’estime de manière générale la communauté scientifique.

La création d’une conscience artificielle progresse

A l’institut Polytechnique de New York, des chercheurs sont parvenus à faire prendre conscience d’eux même à des robots. Le test s’est fait sur 3 robots capables de s’exprimer, les chercheurs ont indiqués aux robots que 2 d’entre eux été devenus muets, sans préciser lesquels. Aucun robot ne sachant lequel été toujours capable de s’exprimer. Ils leur ont ensuite demandé de trouver celui qui n’était pas devenu muet. Les 3 robots ont chacun tenté de répondre qu’ils ne savaient pas. 2 d’entre eux étant devenus muets un seul a pu répondre « je ne sais pas », dès qu’il s’est entendu répondre, le robot s’est repris pour exprimer qu’il connaissait maintenant la réponse. La prise de conscience qu’à exprimé le robot en reconnaissant de manière autonome qu’il n’était pas muet peut-elle être assimilé à une conscience artificielle ? Sans doute pas tout à fait mais il faut reconnaître que le robot à pris conscience de son existence et de celle de son entourage, on est donc assez proche de la création d’une conscience artificielle.

A l’institut Polytechnique de New York, des chercheurs sont parvenus à faire prendre conscience d’eux même à des robots. Le test s’est fait sur 3 robots capables de s’exprimer, les chercheurs ont indiqués aux robots que 2 d’entre eux été devenus muets, sans préciser lesquels. Aucun robot ne sachant lequel été toujours capable de s’exprimer. Ils leur ont ensuite demandé de trouver celui qui n’était pas devenu muet. Les 3 robots ont chacun tenté de répondre qu’ils ne savaient pas. 2 d’entre eux étant devenus muets un seul a pu répondre « je ne sais pas », dès qu’il s’est entendu répondre, le robot s’est repris pour exprimer qu’il connaissait maintenant la réponse. La prise de conscience qu’à exprimé le robot en reconnaissant de manière autonome qu’il n’était pas muet peut-elle être assimilé à une conscience artificielle ? Sans doute pas tout à fait mais il faut reconnaître que le robot à pris conscience de son existence et de celle de son entourage, on est donc assez proche de la création d’une conscience artificielle.

Un système nerveux artificiel greffé sur un robot lui fait ressentir la douleur

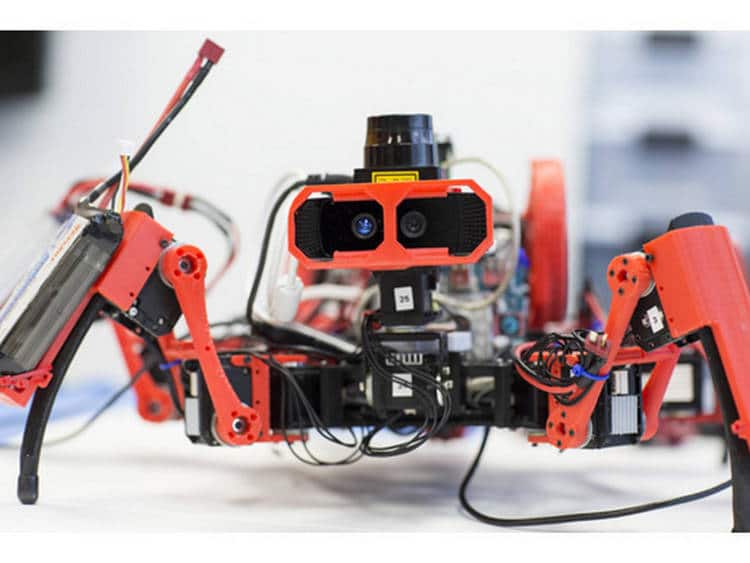

Mais qu’en est-il d’une intelligence artificielle capable d’avoir mal lorsque ses moteurs ou ses systèmes électroniques sont endommagés ? Les travaux d’une équipe de chercheurs de l’Université de Leibniz à Hanovre pourront peut-être bientôt nous faire avancer sur ce sujet. Ils ont en effet conçu un système nerveux artificiel, sur le même modèle qu’un système nerveux humain, qu’ils ont intégré à un bras robotisé de la marque Kuka. Grâce à différents capteurs reliés, le bras peut alors sentir quand on le touche. Incroyable, il se rétracte également de manière plus ou moins importante selon l’intensité du contact. Lors de tests effectués, le bras robotique se retirait vivement au contact de l’eau bouillante, par exemple. Si cette expérience est bien loin de la création d’une conscience artificielle on approche d’une capacité du robot de ressentir l’impact de l’environnement extérieur sur les éléments qui le compose.

Mais qu’en est-il d’une intelligence artificielle capable d’avoir mal lorsque ses moteurs ou ses systèmes électroniques sont endommagés ? Les travaux d’une équipe de chercheurs de l’Université de Leibniz à Hanovre pourront peut-être bientôt nous faire avancer sur ce sujet. Ils ont en effet conçu un système nerveux artificiel, sur le même modèle qu’un système nerveux humain, qu’ils ont intégré à un bras robotisé de la marque Kuka. Grâce à différents capteurs reliés, le bras peut alors sentir quand on le touche. Incroyable, il se rétracte également de manière plus ou moins importante selon l’intensité du contact. Lors de tests effectués, le bras robotique se retirait vivement au contact de l’eau bouillante, par exemple. Si cette expérience est bien loin de la création d’une conscience artificielle on approche d’une capacité du robot de ressentir l’impact de l’environnement extérieur sur les éléments qui le compose.

Ressentir la douleur pour anticiper le danger

Johannes Kuehn, membre de l’équipe de recherche, explique la démarche : « la douleur est quelque chose qui nous protège. Si les humains n’étaient pas capables de ressentir la douleur, ils se blesseraient plus souvent. » L’objectif est ici de donner une faculté supplémentaire (et humaine) aux robots : celle de ressentir la douleur, pour se protéger de manière autonome des actions et interactions qui risqueraient de les endommager. Grâce à ce système nerveux artificiel, le robot peut donc sentir lorsqu’un contact extérieur abîme ses moteurs et ses systèmes électroniques et réagir en fonction. Il peut aussi comprendre à quel moment ses propres actions deviennent trop intenses et s’arrêter avant de « ressentir » la douleur ; un peu comme un humain qui, à force de courir, commencerait à s’essouffler ou avoir un poing de côté.

Johannes Kuehn, membre de l’équipe de recherche, explique la démarche : « la douleur est quelque chose qui nous protège. Si les humains n’étaient pas capables de ressentir la douleur, ils se blesseraient plus souvent. » L’objectif est ici de donner une faculté supplémentaire (et humaine) aux robots : celle de ressentir la douleur, pour se protéger de manière autonome des actions et interactions qui risqueraient de les endommager. Grâce à ce système nerveux artificiel, le robot peut donc sentir lorsqu’un contact extérieur abîme ses moteurs et ses systèmes électroniques et réagir en fonction. Il peut aussi comprendre à quel moment ses propres actions deviennent trop intenses et s’arrêter avant de « ressentir » la douleur ; un peu comme un humain qui, à force de courir, commencerait à s’essouffler ou avoir un poing de côté.

Toujours selon Johannes Kuehn, donner aux robots la faculté de détecter leurs dommages leur permettra d’éviter les accidents et de mieux collaborer avec les humains, mais évidemment, le projet ouvre des perspectives beaucoup plus vertigineuses, notamment dans le domaine de « l’informatique affective », branche de l’intelligence artificielle et d’une conscience artificielle qui passionne de plus en plus de chercheurs.

Des cognitions ou consciences artificielles dès 2029, selon Ray Kurzweil

Ray Kurzweil, pape du transhumanisme embauché par Google en 2012, déclarait pour le magazine Wired qu’en 2029, des programmes « seront capables d’intelligence émotionnelle, d’être drôles, de comprendre des blagues, d’être sexy, aimants et de comprendre l’émotion humaine (…). C’est ce qui sépare les ordinateurs et les humaines aujourd’hui. Je crois que ce fossé va se refermer d’ici 2029. » Bien plus que de comprendre les émotions, les robots en seront-ils dotés ? Comment peut évoluer un monde ou les machines seraient équiper d’une notion d’existence grâce à une conscience artificielle.

C’est assez bluffant le coup du robot qui se reprend une fois qu’il a prit conscience qu’il n’était pas muet ? On avance à grands pas vers l’IA !

Une phrase de l’article me taquine :

« donner une faculté supplémentaire (et humaine) aux robots : celle de ressentir la douleur »

Elle laisse penser que seuls les humains ressentent la douleur. Les humains sont comme beaucoup d’animaux … à moins que les animaux soient une sorte de robot ?

Quelle douleur ressente les animaux ? Loin de moi l’idée de les martyriser, mais n’ayant pour la plupart aucune conscience d’exister et que l’Univers existe, ont-ils la même perception de la douleur ? Chez nous l’humain elle est bcp plus psychique que physique. Quant aux robots qui ressentiraient de la douleur c’est en 2016 une aimable galéjade ou une capucinade dirait monsieur Pivot.

Rhôôôô : est-ce provocateur ou provocateur ?

1) depuis quand faut-il être conscient pour souffrir ? C’est avec ce raisonnement que la douleur chez le bébé n’est prise en compte que depuis moins de 30 ans … et depuis, on a aussi compris que la douleur « totale » abouti à un repli « autistique » puis à la mort. Pourtant la conscience de soi vient plus tardivement …

2) malgré tout nos efforts, les recherches de ces 15 dernières années sur la vie animale montre que tout ce que l’on trouve chez l’homme existe chez l’animal, à un degré autre. Même le coup du l’inceste cher à Papy Freud se retrouve dans l’immense majorité des vertébrés homéothermes (c’est d’ailleurs plus transgressé chez l’homme qu’ailleurs)… la culture, la danse, le langage, le soin des morts ou des nouveaux-nés : tout, je vous dit (sauf peut-être le génocide).

3) quant au ratio douleur physique/psychique, c’est très spécifique à chaque humain et à chaque cause.

Et je dis ça en tant qu’infirmier formé à l’hypnose antalgique…

Et pour revenir aux robots : si pour faire une conscience, il faut tout l’éventail des perceptions humaines (dont la douleur, mais pourquoi pas le sens de l’humour, de la répartie, des valeurs, des responsabilités …), nous sommes autorisés qu’une I.A. dotée de vision infra-rouge et ultra-violette, de capteurs à ultrasons et à FM, de 3 mains et 4 pieds serait sur-humaine du point de vue de la conscience…

Bonjour,

Merci pour votre commentaire, vous avez raison l’expression est sans doute mal choisie. Nous avons voulu opposer le monde animal et le monde de la robotique et de l’IA pour faire prendre conscience qu’un des éléments qui nous distingue est peut être en train de disparaître.

Cordialement

L’équipe Robots et compagnie

Par contre, si l’on considère la « conscience » comme une simulation construite par le cerveau, pourquoi ne serait-elle pas implémentable? reste à définir consensuellement le terme de conscience … bien qu’en hypnose par exemple, on parle plutôt « d’états de conscience ».

Je crois que le terme « ressentir »‘du titre n’est pas du tout approprié .. C’est des capteurs qui informe ….

Tout comme sur l’être humain, on a des capteurs qui informent notre cerveau. La seul différence c’est que nos capteurs sont organiques et ceux des robots sont en général électroniques ^^

…. Lol … Ressentir c’est ressentir … Un robot ne ressens rien … Il n’a pas de sensation il a dès capteurs et des

Lignes de code qui lui disent comment réagir et même avec le deep learning … Vous sublimez à mort les robots … Et l’IA … Il faut rationalisé les articles et les infos à ce sujets …

Une fois reçue l’information par les capteurs, il y a une intégration par le système nerveux central qui transforme le message nerveux en sensation.

Tout le débat reste de savoir si un traitement organique seul peut être baptisé « sensation » (sachant que cette sensation va mobiliser d’autres structures, comme la mémoire) ou si le traitement de l’info de façon numérique pourra s’appeler par analogie, « sensation » ?

Les réflexes humain sont inné, donc ce sont aussi des ligne de code (génétique) …

Cédric Braun sur le plan fonctionnel oui 🙂

il y a autre chose ? :p

Cédric Braun est ce qu’on inclu la nature organique de l’effecteur pour borner le terme sensation ? (c’est une vraie question que je pose, je ne tranche rien pour l’heure)

Ca serait totalement arbitraire

Moi je ne suis pas tranché aussi mais en IA les termes utilisés sont très humain …

On fait des analogie avec ce qu’on connais c’est tout.

Cédric, je ne sais pas, en phylogénétique on utilise fréquemment la nature des structures pour inclure/exclure les espèces de certains groupes.

Ok ok c’est moi qui m’emballe un peu trop alors :p

Quand on parle de

Conscience !! En IA cela me fait rire …’déjà que l’on a du mal à le comprendre pour nous en organique

c’est bien le probleme, on ne sais pas raisonner autrement qu’avec des petite cases.

C’est bien pratique c’est vrai, mais la nature est une evolution continue, il n’y a jamais de cassure nette, on est obliger d’etre arbitraire

Notre classification/modèle est valide s’il permet de rendre compte d’un grand nombre de phénomène, j’avoue ne pas avoir assez de recul sur la robotique pour trancher la validité du modèle animal dessus.

Je n’ai rien contre les grandes cases, pour peu qu’elles démontre leur efficience.

1) d’un côté le modèle animal pour décrire les robots peut être efficient parce que les robots sont construits à l’imitation du vivant mais…

2) comme cette imitation est très grossière pour l’heure, le vivant peut montrer bien d’autres caractéristiques essentielles que les robots n’ont pas, d’où la prudence Ponziesque.

Tout va bien temps que ces case nous serve de classification neutre.

Le probleme ce pause quant elle deviennent un moyen de hiérarchisation de valeur.

La douleur humaine, qui aurait plus de valeur que la douleur animal, qui aurait plus de valeur que la douleur robotique. etc

Sans aller dans l’échelle de valeur, qui est un positionnement moral, je m’intéresse au nombre de faits qu’on peut expliquer et prévoir.

» prudence Ponziesque » j’adore ^^

Ben c’est très bien je comprend le concept, mais un truc me chiffonne imaginons et je me répète Imaginons que le robot ne nous aide pas si on est en danger de peur de se blesser !?

Très juste. Normalement un robot devrait aider un humain même si cela devrait entraîner sa destruction

Bientôt le robot aura un choix cornélien. Fais je ou non aider l’humain au risque de ma « vie »

La notion de douleur est évidemment identique à la représentation des interactions avec l’environnement. C’est l’essentialisation de la différence homme/IA qui cause l’incompréhension de cette banalité (cf. http://www.exergue.com/h/2016-06/tt/philosophie-ia.html).

…Et si, malencontreusement, je renverse ma tasse de thé sur mon robot… ne va-t-il pas me faire mal aussi ?… et si je lui marche sur le pied ?…

Après je pense qu’il y a 2 type de recherche fondamentale une pour arriver à faire un robot qui ressemble à l’homme un challenge technologique mais qui ne sert pas à grand chose et un autre à faire des robots qui nous aident à toutes les taches pénible, travail, aide etc ( voiture autonome etc .. ) etc ….